L’Era della Maturazione Operativa

Il 2026 non è più l’orizzonte futuribile dell’Intelligenza Artificiale, ma il presente operativo di un’ingegnerizzazione sempre più sofisticata. L’attenzione si è spostata dalla pura ricerca di performance all’ottimizzazione dell’intero ciclo di vita del modello: dalla produzione (training e fine-tuning) alla scalabilità (deployment e gestione in produzione). La sfida non è più “creare il modello più grande”, ma “rendere il modello giusto efficiente, affidabile e sostenibile”.

Le Tendenze Chiave della Produzione

La produzione di modelli nel 2026 è guidata da tre pilastri:

- Modelli Specializzati e Piccoli (Small Language Models – SLM): Contrariamente alla corsa ai parametri, prevale l’ottimizzazione per domini specifici (legale, medico, manifatturiero). Questi modelli, spesso basati su architetture efficienti (es. Mistral-style, MoE), richiedono meno dati di training e computazione, facilitando la produzione interna (in-house) e riducendo la dipendenza da pochi vendor.

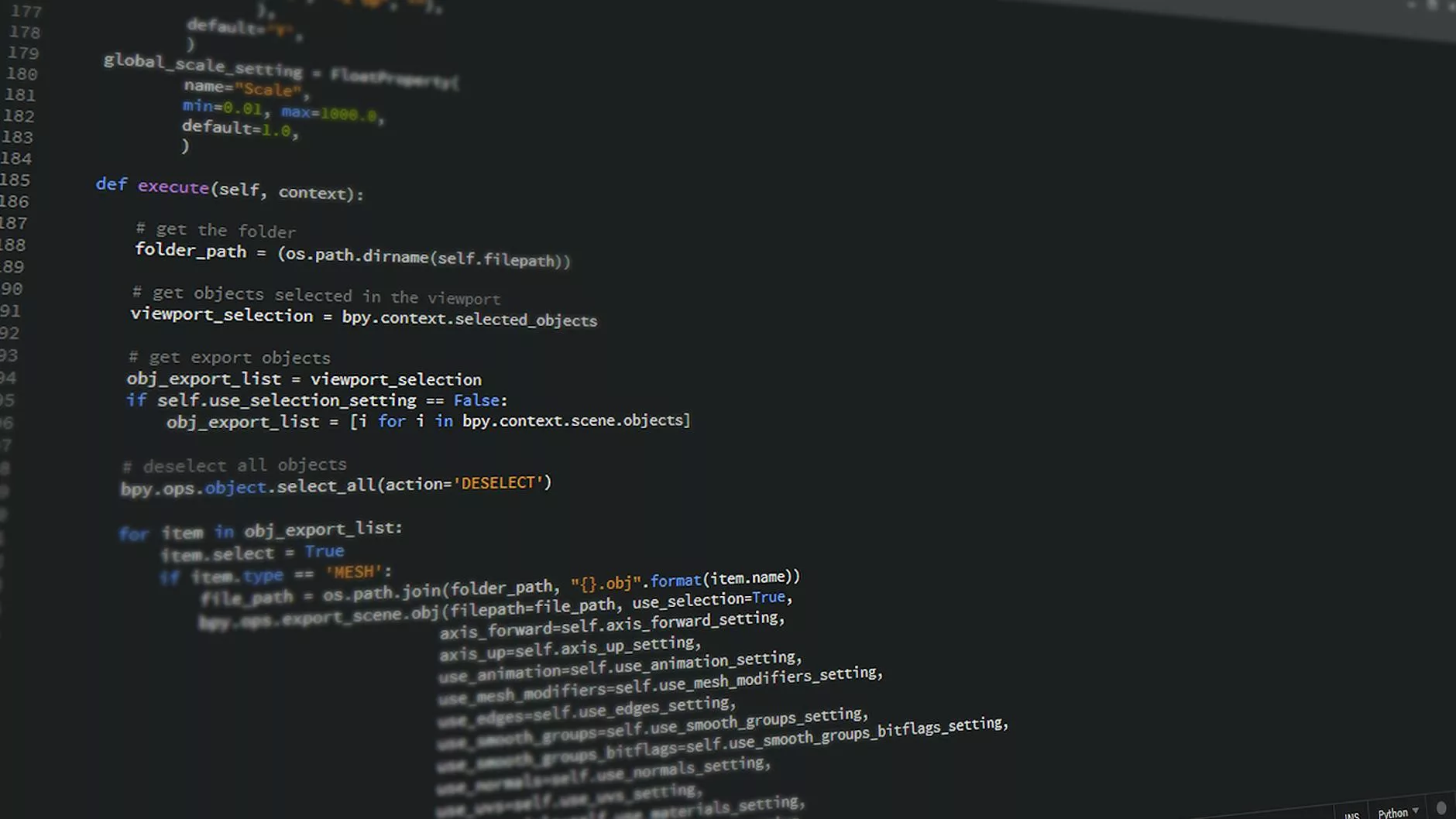

- Fine-Tuning Automatico e Controllato (RLHF/RLAIF su scala): Il processo di allineamento del modello ai valori aziendali e alle linee guida etiche è automatizzato e integrato nel pipeline CI/CD del modello. Strumenti di valutazione automatizzati e dataset di alta qualità curati da esperti di dominio sono centrali.

- Synthetic Data & Data-Centric AI: La scarsità di dati etichettati di alta qualità per scenari particolari (es. difetti di produzione rari) viene superata dalla generazione controllata di dati sintetici tramite generative model, rendendo la produzione più rapida e meno dipendente dalla raccolta reale.

Scalabilità: Oltre il Cloud,verso l’Edge e l’Ibrido

Scalare un modello non significa solo aumentare le GPU in un cluster cloud. Nel 2026, l’architettura è ibrida e pervasiva:

- Inferenza all’Edge (Edge AI): Modelli ottimizzati (quantizzati, potati) vengono distribuiti su dispositivi IoT, sensori e gateway. Questo riduce la latenza, preserva la privacy e abilita decisioni in tempo reale senza dipendere dalla connettività cloud. L’ingegneria qui si concentra sulla compressione estrema e sulla gestione dell’hardware eterogeneo.

- Infrastruttura Serverless per AI: I deployment sfruttano piattaforme serverless (es. AWS Lambda, Google Cloud Run) per carichi di inferenza variabili, scalando automaticamente da zero a migliaia di richieste con costi legati all’uso effettivo, eliminando la gestione dell’infrastruttura sottostante.

- Orchestrazione Multi-Model e A/B Testing nativo: Più versioni di un modello (es. SLM vs. LLM, diverse regioni) possono essere gestite simultaneamente da un orchestrator (es. KServe, Seldon) che instrada il traffico in base a metriche di costo, latenza e accuratezza, abilitando sperimentazioni continue in produzione.

Il Cuore della Scalabilità: MLOps 2.0

L’MLOps è evoluto in una piattaforma unificata e self-service per i data scientist e gli ML engineer. Le caratteristiche distintive includono:

- Pipeline GitOps: L’intero ciclo di vita (dati, codice modello, configurazione) è gestito come codice in Git. Eventuali modifica in produzione avviene tramite merge request con revisione automatica e manuale.

- Monitoraggio Proattivo del Drift: Oltre alle performance (latency, throughput), si monitora costantemente il drift concettuale dei dati in ingresso e la deriva delle previsioni del modello. Allarmi automatici scattano per suggerire un retraining.

- Traceability e Audit Completi: Ogni previsione è tracciabile alla specifica versione del modello, al dataset di training e ai parametri utilizzati, requisito fondamentale per settori regolamentati (finanza, sanità).

Sfide Critiche sul Percorso

Nonostante i progressi, permangono ostacoli significativi:

- Sostenibilità Energetica: Il costo energetico del training e dell’inferenza su larga scala è sotto la lente d’ingrandimento. L’ingegneria deve ottimizzare non solo per le FLOPS, ma per le FLOPS/Watt, scegliendo architetture efficienti e hardware specializzato (ASIC per AI).

- Gap di Competenze: La figura dell’AI Engineer deve padroneggiare non solo machine learning, ma anche ingegneria del software (DevOps, SRE), ottimizzazione hardware e conoscenze di dominio.

- Governance e Sicurezza Intrinseca: La scalabilità amplifica i rischi. È essenziale progettare modelli robusti contro avversarial attack, con meccanismi di content moderation integrati e policy di accesso granulari.

Conclusione: Verso un’Ingegnerizzazione Predittiva

Il 2026 segna la transizione da un’AI engineering reattivo a uno predittivo e olistico. Il successo non sarà misurato solo dall’accuratezza di un modello in laboratorio, ma dalla sua capacità di essere prodotto in modo efficiente, scalato in ambienti eterogenei e gestito nel tempo con costi e rischi controllati. Le aziende che padroneggeranno questa “produzione su scala industriale” di modelli AI otterranno un vantaggio competitivo duraturo e sostenibile.